| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 | 31 |

- 말해보시개 딥러닝

- git log

- aws rds

- AWS Certificate

- 쏴아리 딥러닝

- unsupervised learning

- DCGAN

- autoencoder

- Image to image translation

- gan

- docker

- linux

- ubuntu

- ubuntu 명령어

- git commit

- CycleGAN

- ubuntu mount

- AWS

- 말해보시개 Linux

- AnoGAN

- AWS EC2

- pix2pix

- bash vs zsh

- anomaly detection

- ubuntu grep

- ubuntu zsh

- EC2

- ubuntu pipe

- bash 명령어

- F-AnoGAN

- Today

- Total

쏴아리의 딥러닝 스터디

f-AnoGAN: Fast unsupervised anomaly detection with generative adversarial networks(2019) 본문

f-AnoGAN: Fast unsupervised anomaly detection with generative adversarial networks(2019)

말해보시개 2021. 4. 17. 16:51f-AnoGAN: Fast unsupervised anomaly detection with generative adversarial networks(2019)

Abstract

1. 의료 이미지의 이상여부 Label을 얻는 작업은 time-consuming하고 비현실적입니다.

의료 이미지에 대한 전문가의 라벨을 얻는 것은 time-consuming 하고 매우 어려운 작업입니다. 또한 사전에 알려진 모든 가능한 라벨을 annotation 하는 작업은 불가능하고, 또한 guide annotation도 충분히 잘 묘사하기 힘든 경우가 있습니다. supervised learning 방법론은 전문가의 labeled training data가 있다면 좋은 결과를 낼 수 있지만, 라벨이 반드시 존재해야 하는 한계점이 존재합니다.

2. f-AnoGAN은 비지도학습기반의 이상탐지 방법이며, fast mapping technique의 특징이 있습니다.

본 연구에서는 fast AnoGAN(f-AnoGAN)을 제안합니다. f-AnoGAN은 generative adversarial network(GAN) 기반의 비지도 학습 방법론 접근 방법으로, 이상한 이미지와 이미지 세그먼트를 탐지함으로서, 의료 이미지에서 문제가 되는 후보군을 도출 할 수 있습니다. 본 연구에서는 generative model을 healthy training data로 부터 훈련하고, 새로운 테스트 데이터에서 GAN's latent space로의 fast mapping technique을 제안합니다. Mapping 작업은 trained encoder를 통해 이루어지며, anomaly detection 작업은 feature redisual error와 image reconstruction error를 합친 anomaly score에 기반합니다.

3. f-AnoGAN의 실험결과는 정량적, 정성적 평가에서 긍정적입니다.

실험결과 OCT(optical coherence tomography) data에서, f-AnoGAN이 다른 방법론들 보다 정량평가에서 좋은 성능을 보여주는 것을 보여주었으며, 망막전문가 시각적인 테스트(정성평가)에서도 실제 이미지와 f-AnoGAN의 생성이미지의 차이가 없음을 확인하였습니다.

Introduction

본 연구에서는 annotation 작업이 필요 없이 대규모 only normal images를 훈련데이터로 사용하는 fast anomaly detection technique을 제안합니다. Generarative model은 Normal Data를 활용한 비지도 학습을 통해, 대규모 훈련 데이터의 natural variability를 학습합니다. 그 후, encoder를 훈련하여 images가 latent space로 fast mapping을 수행할 수 있도록 하며, 이상탐지 단계에서 normal data의 manifold에 fit한지 아닌지의 여부를 빠르게 평가할 수 있습니다.

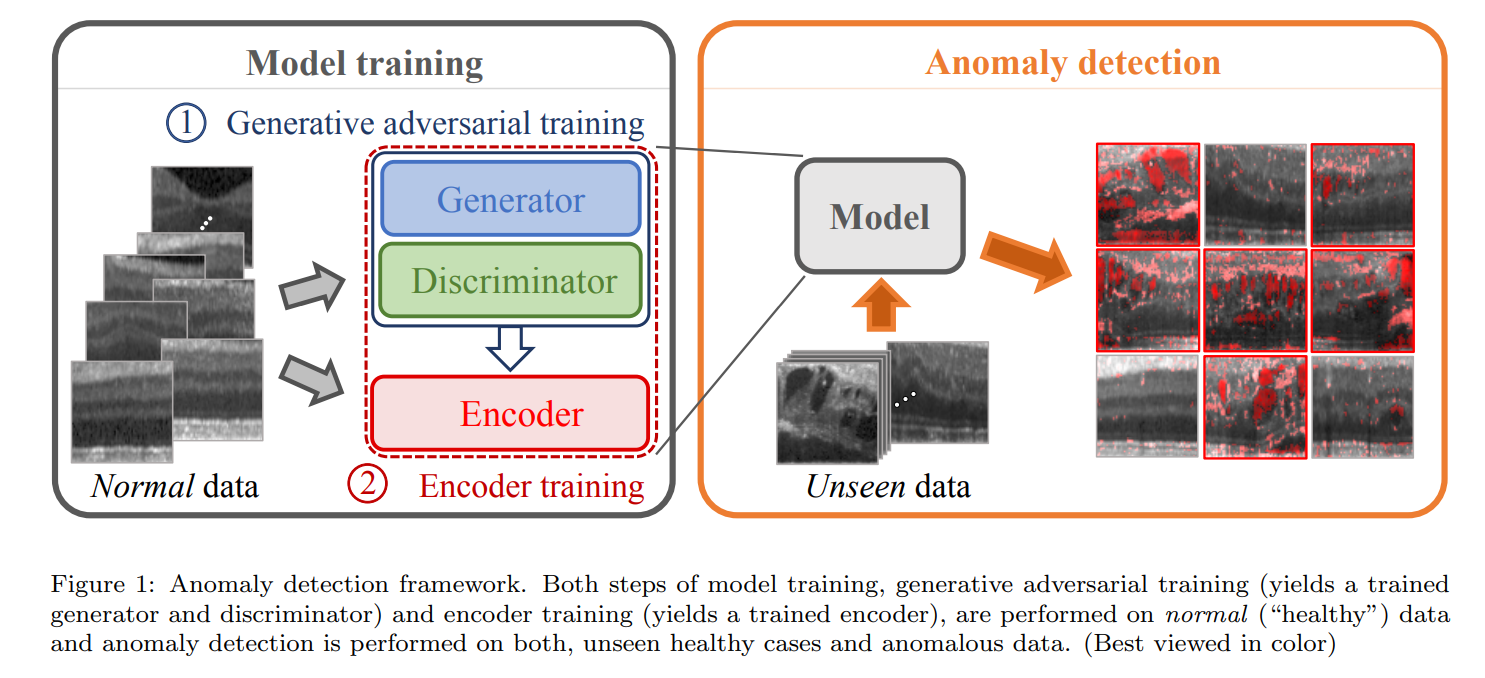

Figure 1) Anomaly detection Framework

1) Model Training

- 모델 훈련단계에서는 normal "healthy" data만 사용합니다.

- generative adversarial training을 수행하여 Generator와 Discriminator를 학습합니다.

- Encoder training을 수행하여, trained encoder를 학습합니다.

2) Anomaly detection

- 이상탐지 단계에서는 normal "healthy" data와 훈련데이터에 존재하지 않은 unseen healthy cases, anomalous 데이터를 함께 활용합니다.

Fast GAN based anomaly detection

본 연구에서 제안하는 anomaly detection framework는 normal image를 활용한 2가지 training step으로 구성됩니다.

(1) GAN Training(WGAN training)

- AnoGAN(2017)과 유사하게 GAN을 normal 이미지로부터 학습하여 generator와 discriminator를 만들고, normal anatomical variability의 latent representation을 만듭니다.

- 이 GAN model을 활용하여, image로 부터 latent space로의 encoder를 학습하게 되는데, 이 과정은 Figure 2에 표현되어있습니다.

(2) Encoder Training based on the trained GAN model(izi encoder training or ziz encoder training)

- encoder training 이후, input이 trained generator에 입력되면 encoder는 이미지를 latent space로 맵핑합니다.

- normal image가 입력될 경우 enocder를 통해 image space로부터 latent space로 맵핑되고, 그 이후 generator를 통해서 latent space에서 다시 input space로 맵핑됩니다

훈련 이후, inference는 위의 (1), (2) 훈련 모듈에 기반하여 새로운 이미지에 대하여 anomaly score를 계산합니다.

Figure 2) Components of the proposed anomaly detection framework training

(1) Wasserstein GAN(WGAN) Training

- WGAN을 훈련하여 Generator G와 Discriminator D의 learned parameter를 얻습니다.

(2) encoder trainig

- Fixed Parameter G, D를 활용하여 3가지 가능한 encoder training 옵션이 있습니다.

1) izi encoder training

- input images와 "reconstructed" images 간 residual에 기반하여 Loss Lizi를 최소화 합니다.

2) izif encoder training

- Loss Lizi와 Lodd LD를 jointly training합니다.

- Loss Lizi는 input images와 "reconstructed" images 간 residual에 기반합니다.

- LD는 input images와 "reconstructed: images간 disciminator의 feature간 redisual을 의미합니다.

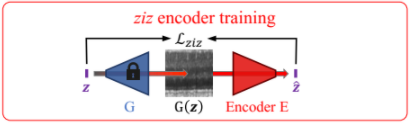

3) ziz encoder training

- Loss Lziz를 최소화 합니다.

- Lziz는 randomly sampled 와 reconstructed locations의 z-space(latent space)에서의 residual에 기반합니다.

Training the encoder with generated images: ziz architecture

- 훈련동안, z-space에서 random sample을 fixed Generator G에 통과 시키고, 그 결과를 Encoder E에 통과시켜서 z-hat을 획득합니다.

- input z-samples 와 reconstructed z-samples E(G(z))간의 mean squared error(MSE)를 최소화합니다.\

- 다음 수식에서 d는 z-space의 dimensionality를 의미합니다.

- input z-samples 와 reconstructed z-samples E(G(z))간의 mean squared error(MSE)를 최소화합니다.\

- izi architecture와 다르게, ziz architecture에서는 true target z location을 알 수가 있는데, 이 방법론은 오직 encoder가 generated images만 활용하고 real images를 활용하지 않는다는 단점이 있습니다.

- 본 연구에서는 izif architecture를 활용한다고 합니다.

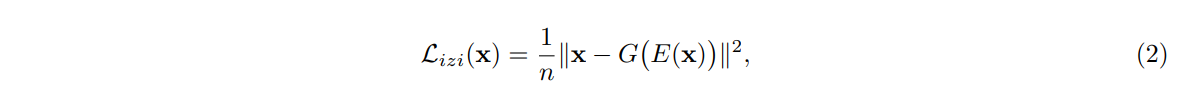

Training the encoder with real images: izi architecture

- izi archecture는 standard Autoencoder의 환경 즉, enocoder 뒤에 docoder(generator)가 있는 구조로 되어있습니다.

- 훈련 기간 동안, real images는 trainable encoder를 통과하여 latent encoding z-hat을 생성하고, z-hat은 다시 fixed Generator G를 통과하여 Reconstucted Images를 생성합니다.

- input images x 와 reconstructed images G(E(x))간 MSE redisual loss를 최소화합니다.

- izi encoder는 WGAN training에서와 동일한 데이터(only normal images)를 통해 학습됩니다.

- 이 방법론은 query image에 대한 z-space의 true target location을 알수 없다는 단점이 있습니다.

- 간접적으로 image와 z mapping, 다시 z로부터 image로 되돌아오는 작업을 통해 image-to-image residual로 accuacy를 측정합니다.

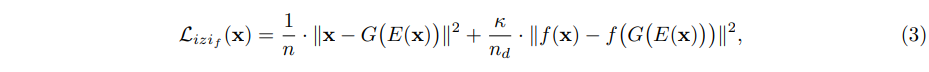

Discriminator guided izi encoder training: izif architecture

izi training의 한계점

- izi training의 object가 image space에서의 similatiry를 image space에서 enforce합니다.

- 훈련기간동안 새로운 이미지의 mapping은 latent space에서의 position을 sparsely sampled 되게 할 수 있으며, 다시 image space로 되돌아 갔을때 discriminator를 convince하지 못할 것입니다.

- 그 결과, 오직 pixel-wisw differences를 최소화하는 것은 realistic하지 않은 nomal images만 생성 할 수 있고, anomalous images들에 대해 작은 residual을 갖게 할 수도 있습니다.

discriminator의 feature space간 residual의 의미

- 본 연구에서는 discriminator로 부터 populated된 feature space간 resisual은 anomalous images를 탐지하기 위한 핵심적인 조건인 것을 발견하였습니다.

- 따라서 본 연구에서는 real image와 reconstructed image의 결과를 izif architecture에서 추가적으로 계산하였습니다.

discriminator guided izi encoder training

- Loss function은 다음과 같습니다.

- f는 disciminator의 intermediate layer feature입니다.

- nd는 intermediate feature representation에서의 dimensionality입니다.

- k는 weighting factor입니다.

- Discriminator의 parameters는 WGAN training에서만 학습되고, encoder training에서는 fixed 상태로 유지됩니다.

- izif architecture가 image space와 latent space를 동시에 encoder training이 가이드 하기 떄문에, 본 연구에서는 izif를 f-AnoGAN framwork에서의 propesed encoder training architecture로 선정하였습니다.

Detection of Anomalies

anomaly quantification

- anomaly quantification을 위한 formulation은 encoder training에서 활용된 loss를 사용합니다. (Equation (1) ~ (3))

- dissciminator guided izif encoder training(Equation (3))에 기반한 f-AnoGAN 모델은 다음과 같이 정의된 final anomaly score A(x)를 사용합니다.

- x는 새롭게 입력된 이미지 입니다.

Figure 3) Inference on new images for anomaly scoring

- Anomaly Scoring은 encoder training에서 활용된 dataflow와 같은 architecture를 사용합니다.

(a) Proposed f-AnoGAN

- Discriminator guided encoder training을 사용한 f-AnoGAN 모델(izif architecture)

- AR(x)

- Real image x가 Encoder E 에 입력하면 그 결과로 E(x)가 생성됩니다.

- E(x)를 Generator G에 입력하면 G(E(x))가 생성됩니다.

- 이때 real image x와 reconstructed image G(E(x))에 기반한 loss를 AR(X)로 정의합니다.

- AD(x)

- Real image x와 reconstructed image G(E(x))를 discriminator D에 입력하여, Discriminator의 intermediate layer에서의 feature representation을 비교하여 loss AD(x)를 계산합니다.

- AR(x)

(b) Anomaly quantification

- discriminator based term 없이, (izi architecture와 ziz architecture)encoder training architrecure를 위한 anomaly quantification

pixel level anomaly localizaion

- 다음 수식은 absolute value of pixel-wise residuals을 의미합니다.

- 이것은 pixel-level anomaly localization에 활용됩니다.

Experiments

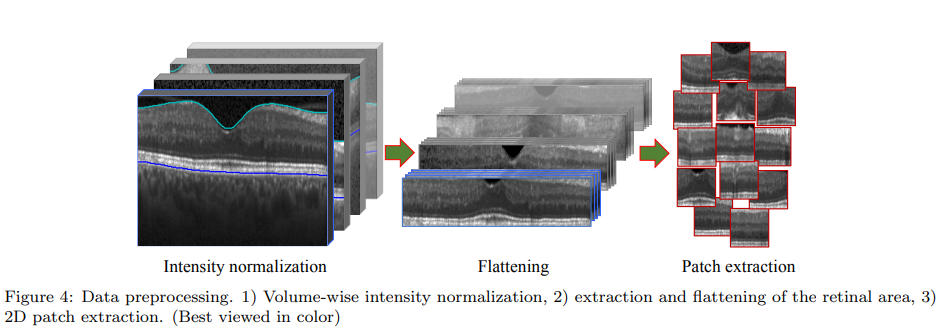

Figure 4) Data preprocessing

- Figure 4는 OCT 스캔으로 부터 2D iomage patches로의 date preprocessing step의 overview를 보여줍니다.

- 1) Volume-wise intensity normalizaeion

- 2) retinal area를 extraction and flattening

- 3) 2D patch extraction

f-AnoGAN 모델은 normal variability를 smoth representation으로 적절히 capture합니다.

Figure 5) Interpolations in the z-space of the trained WGAN

- First 3 rows

- z-space에서 randomly sampled endpoint간의 Linear interpolation

- Last 3 rows

- z-space에서 훈련데이터의 real image를 condition으로 하여 생성한 2 z location간의 Linear interpolation

- 제안된 encoder는 주어진 guery이미지로 부터 대응되는 latent encoding을 찾을 수 있음을 확인할 수 있다.

f-AnoGAN 모델은 training data가 아닌 주어진 input image에 대하여, visually close normal image를 찾을 수 있고, 이는 anomaly detection의 선행조건입니다. 해당 내용은 Figure 6에서 확인이 가능합니다.

Figure 6) 모델간 anomalous image region의 pixel-level localization 비교

- first row: real input images

- second row: Pixel-level anomaly anootations

- First block: training set(normal images)로부터 취득된 images

- Second block: test set에서의 healthy cases로 부터 취득된 normal images

- Third block: test set에서 diseased cases로 부터 extracted된 images

Figure 7) Encoder training 방법론간 anomaloys image region에 대한 pixel-level localization 비교

- Figure 7은 query images를 reconstruct하는 3가지 encoder training 방법론이 anomaly localitzation을 잘 수행할 수 있는지 시각적으로 보여줍니다.

- first row: real query images

- third row: f-AnoGAN으로 부터의 generated images

- fourth row: real query images와 f-AnoGAN의 generated images간 overlayed residual

Figure 8) Image-level anomaly detection accuracy evaluation

- (a) 다양한 모델들과 f-AnoGAN의 ROC curve, AUC 성능을 함께 보여줍니다.

- f-AnoGAN의 AUC가 0.9301로 가장 높은 성능을 보여주었습니다.

- (b) 3가지 encoder training architecture를 적용한 f-AnoGAN의 ROC Curve, AUC 성능을 보여줍니다.

- izif를 적용한 f-AnoGAN의 AUC사 0.9301로 가장 높은 성능을 보여주었습니다.

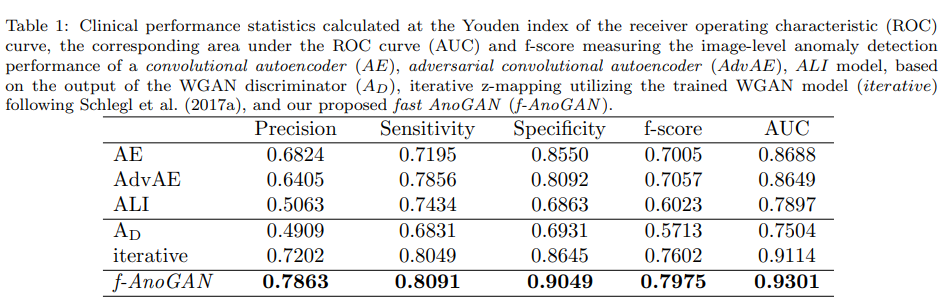

Table 1) Clinical performance statistics

- 다양한 모델들에 비해 f-AnoGAN이 Precision, Sensitivity, Specificity, f-score, AUC 모든 metric에서 최고의 성능을 보여주었습니다.

Table 2) 3개 encoder training architecure를 사용하였을 때의 f-AnoGAN의 성능평가

- izif encoder training architecture가 Precision, Specificty, f-score, AUC의 metric에서 최고의 성능을 보여주었습니다.

- Sentivitry metric에서는 ziz encoder training architecture가 최고의 성능을 보여주었습니다.

Conclusion

1. 본 논문에서는 GAN related encoder training procedure를 활용한 fast anomaly detection 방법론을 제안하였습니다.

- f-AnoGAN을 만들기 위하여, healthy example로 WGAN을 훈련합니다.

- 그 뒤, images를 latent space로 mapping 하기 위한 encoder를 학습합니다.

- encoder는 fast inference 와 anomaly detection을 위해 사용됩니다.

- 이상탐지를 수행할 때, input images와 reconstructed images를 활용하여 reconstruction residual, residual on discriminator feature를 계산하고, 이는 anomalies를 찾기 위한 marker를 도출하는데 활용됩니다.

2. 3가지 encoder training approaches를 조사하였습니다.

- 1) ziz encoder training architecture

- image로부터 latent encodings를 mapping하기 위한 encoder를 만듭니다.

- ziz encoder training의 objective가 latent space만 training에 활용하기 때문에, normal query images에도 anomaly detection에 accuracy가 제한된다는 한계점이 있습니다.

- 2) izi encoder training architecture

- smooth reconstruction을 생성합니다.

- 3) izif encoder training architecture

- WGAN discriminator를 포함해서 encoder를 taining합니다.

- beset anomaly detection과 localization result를 생성합니다.

같이 보시면 좋아요.

포스팅 내용이 도움이 되었나요? 공감과 댓글은 큰 힘이 됩니다!

'Anomaly Detection' 카테고리의 다른 글

| Unsupervised Anomaly Detection with Generative Adversarial Networks to Guide Marker Discovery(2017) (0) | 2021.04.16 |

|---|